Agenten-Boom: Adobe bringt gleich 10 KI-Agenten

Die stärkste AI-Community und -Lernplattform Deutschlands

Hey! Willkommen zurück zu deinem wöchentlichen AI-Update! Dein Newsletter für die KI-Revolution - immer up-to-date und einen Schritt voraus!

Heute habe ich für dich:

Die wichtigsten News der Woche 🔥

Erkenntnis der Woche: Nvidia & Yum Brands: KI soll Fastfood noch faster machen 🍔

5 Nützliche AI-Tools 🤖

AI-Tutorial der Woche: Code mit KI direkt im Editor bearbeiten 👨🏻💻

🔥 AI-NEWS

Nvidia stellt nächste KI-Chip-Generation und offenes Modell für humanoide Roboter vor

Nvidia hat auf der GPU Technology Conference die nächste Generation von KI-Chips vorgestellt. Der Blackwell Ultra Chip, ab Mitte 2025 verfügbar, bietet zunächst 50 % mehr Rechenleistung. Der Vera Rubin Chip, geplant für 2026, enthält eine speziell entwickelte CPU namens Vera und verdoppelt die AI-Performance im Vergleich zum Blackwell-Chip. Die neuen Chips sollen die Betriebskosten für KI-Software senken und den wachsenden Anforderungen gerecht werden.

Zusätzlich präsentierte Nvidia mit Isaac GR00T N1 das weltweit erste offene Foundation Model für humanoide Roboter. Das Modell kombiniert schnelle Reflexe mit strategischem Denken und ermöglicht vielseitige Roboterfähigkeiten wie Greifen und Transportieren.

Unterstützt wird das Ganze durch die neue Newton-Physik-Engine, die in Zusammenarbeit mit Google DeepMind und Disney Research entwickelt wurde, um Roboter präziser und anpassungsfähiger zu machen.

Google präsentiert Gemma 3: KI-Power auf nur einer GPU

Google hat Gemma 3 vorgestellt, eine neue Reihe seiner offenen KI-Modelle, die trotz kompakter Größe mit größeren Systemen wie etwa Metas Llama 405B und Deepseeks V3 mithalten kann. Das Besondere: Die Modelle laufen auf nur einer GPU oder TPU. Die Gemma-3-Modelle kommen in vier verschiedenen Größen mit 1, 4, 12 und 27 Milliarden Parametern. Sie unterstützen 140 Sprachen, analysieren Bilder, Texte und kurze Videos und verfügen über ein 128K-Token-Kontextfenster. Einziger Haken: Für optimale Leistung wird eine NVIDIA H100 GPU (PCle) benötigt – mit einem Preis von umgerechnet rund 38.000 Euro.

Zusätzlich hat Google diese Woche ShieldGemma 2 veröffentlicht, ein Tool zur Erkennung expliziter Inhalte in Bildern.

Google erweitert Gemini Flash mit neuen Bildfunktionen

Google hat eine neue Bildgenerierungsfunktionen für sein Gemini 2.0 Flash-Modell eingeführt – Gemini 2.0 Flash Experimental. User können damit Bilder direkt im Chat erstellen, hochladen und bearbeiten – ohne ein separates Bildgenerierungssystem. Eine solche direkte Integration ins Chatfenster gab es in dieser Form bislang nicht.

Eine heiß diskutierte Fähigkeit: Das Programm kann Wasserzeichen entfernen. Eine Funktion, die möglicherweise auch zu unethischem Einsatz verleitet und Urheberrechte infrage stellt.

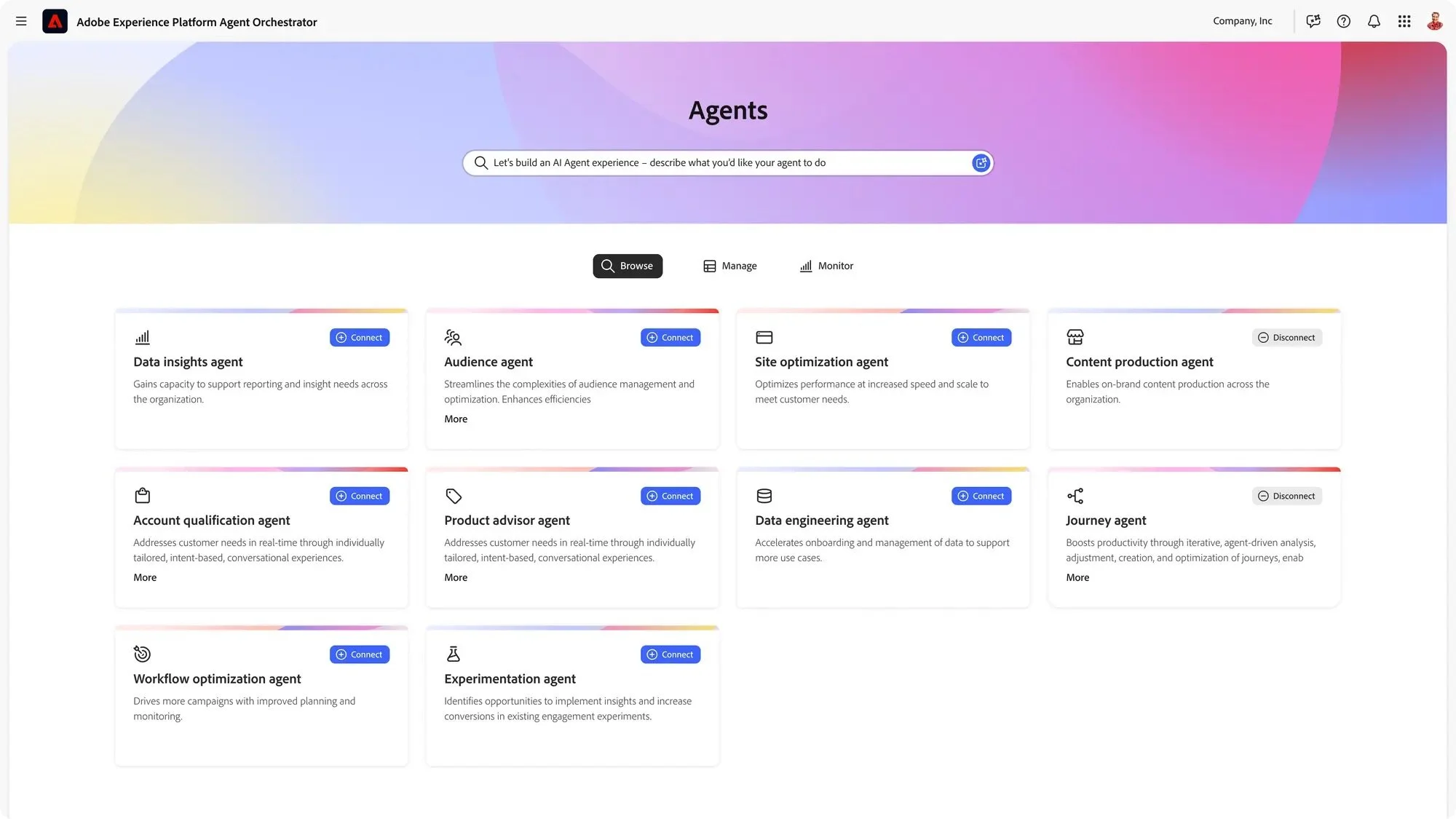

Adobe bringt zehn autonome KI-Agenten in die Experience Cloud

Adobe hat auf dem Adobe Summit 2025 autonom arbeitende KI-Agenten für die Adobe Experience Cloud vorgestellt. Mit der Einführung des "Agent Orchestrator" können zehn KI-Agenten nun direkt mit Kunden kommunizieren und Unternehmen bei der Optimierung von Websites, der Erstellung von Inhalten sowie der Zielgruppendefinition unterstützen. Die Agenten nutzen Kundendaten, um Marketingstrategien gezielt anzupassen und den Verkaufsprozess eigenständig zu optimieren.

Baidu bringt ultra-günstige KI-Modelle auf den Markt

Der chinesische Tech-Riese Baidu hat zwei neue KI-Modelle vorgestellt: ERNIE 4.5 und Ernie X1. ERNIE 4.5 überzeugt mit verbesserten Fähigkeiten in Sprache, logischem Denken und Kodierung – und das zu nur 1 % der Kosten von GPT-4.5 (ca. 0,55 bis 2,20 Dollar pro Million Tokens).

Der Ernie X1, Baidus erstes Modell für komplexe Denkprozesse, bietet ähnliche Leistung wie der Wettbewerber DeepSeek R1, jedoch zu nur der Hälfte des Preises. Diese günstigen KI-Modelle könnten den Beginn eines globalen Preiswettbewerbs im KI-Markt markieren und den Zugang zu fortschrittlicher KI weltweit erleichtern.

Zooms AI Companion bekommt Agentenfunktion

Zoom hat eine Erweiterung seines AI Companion vorgestellt: Der Companion, Zooms intelligenter KI-Assistent, wurde mit agentischen Fähigkeiten erweitert und kann jetzt Aufgaben eigenständig erkennen und automatisch erledigen – von der Terminplanung bis zur Dokumentenerstellung. Er erkennt automatisch Aufgaben aus Meetings und setzt sie um, ohne dass der User eingreifen muss. Weitere Neuerungen sind Kalenderverwaltung, Transkription von Sprachaufnahmen und Live-Notizen. Ab April gibt es zudem ein kostenpflichtiges Abo, das personalisierte AI-Coaches und Avatare für Video-Nachrichten anbietet. Zoom bleibt seiner „AI-first“-Strategie treu und könnte sich so als Vorreiter in der Automatisierung von Arbeitsabläufen positionieren.

Roblox startet Open-Source AI für 3D-Generierung

Roblox hat mit Cube 3D ein neues Open-Source-AI-System vorgestellt, das Entwicklern ermöglicht, 3D-Objekte und ganze Szenen aus Text-Prompts zu generieren. Anders als viele bisherige Modelle nutzt Cube 3D keine 2D-Bilder als Basis, sondern arbeitet direkt mit nativen 3D-Daten. Dadurch entstehen detailreichere und funktionale Meshes (die Grundstruktur von 3D-Objekten) in Sekundenschnelle.

Besonders spannend: Cube 3D kann auch 4D-Modelle erstellen, also Objekte, die sich im Laufe der Zeit verändern oder animiert sind. Das Modell steht ab sofort zur Verfügung und kann individuell angepasst werden. Roblox plant, die Technologie weiter auszubauen – mit komplexeren Objekten und erweiterten Tools für die Spieleentwicklung.

🧠 ERKENNTNIS DER WOCHE

Nvidia & Yum Brands: KI soll Fastfood noch faster machen

Letzte Woche war ich bei Ikea. Self-Scan, na klar. Auf dem Bildschirm ploppte nach dem Bezahlen noch das Bild einer Zimtschnecke auf. “Willst du noch eine Zimtschnecke im Bistro bestellen, hier bezahlen und gleich abholen?” Ja logisch!

Und schon bin ich in die Verkaufsfalle getappt. Denn mal ehrlich: Ohne diese Frage auf dem Display wäre ich sicherlich ohne Zimtschnecke aus dem Blau-Gelben-Möbelhaus gegangen. An einer langen Schlange voller Hot-Dog-hungriger Besucher hätte ich mich nicht noch angestellt. Digitale, smarte Bestellprozesse funktionieren. Kein Wunder, dass immer mehr große Fastfood-Ketten auf KI in ihren Restaurants setzen wollen.

Erst letzte Woche haben wir euch von McDonald’s KI-Plänen berichtet. Yum Brands, das Mutterunternehmen von Taco Bell, Pizza Hut und KFC, möchte nun mit einer viel radikaleren Vision durchstarten: Sprach-KIs sollen Drive-Throughs und Telefonbestellungen übernehmen. Technologieriese Nvidia liefert dafür die nötige Rechenpower und Software. Ziel ist es, Bestellungen vollständig digital abzuwickeln. Bereits im zweiten Quartal startet der Rollout in 500 Restaurants.

KI wird zum neuen Verkäufer – und das aus gutem Grund

Studien zeigen: Wer digital bestellt, gibt mehr Geld aus. Ein KI-Assistent kann unermüdlich Upselling betreiben, personalisierte Angebote ausspielen und durch clevere Empfehlungen den Umsatz steigern. Dagegen ist die klassische "Willst du noch Pommes dazu?"-Frage bei McDonald’s Firlefanz.

KI kann aber noch viel mehr, als unsere Schwachpunkte beim Bestellen finden. Nvidia hilft Yum Brands auch dabei, Bestellfehler mit Computer Vision zu minimieren und Social-Media-Feedback in Echtzeit auszuwerten. Die Strategie ist klar: mehr Automatisierung, weniger Menschen, maximale Effizienz.

Was bedeutet das für die Zukunft von Fast Food?

Die Fast-Food-Branche steht offensichtlich vor einer Umwälzung. Mit immer mehr KI-Einsatz werden Prozesse nicht nur schneller, sondern auch smarter. Bestellungen werden effizienter abgewickelt, Fehler minimiert und der Umsatz durch personalisierte Angebote gesteigert (der Zimtschnecken-Effekt).

Doch diese Entwicklungen werfen auch Fragen auf: Was passiert mit den vielen Service-Mitarbeitenden? Und ist die Kundenexperience wirklich "besser", wenn der persönliche Kontakt fehlt und wir nur noch mit KIs kommunizieren? Wie verändern sich unsere Erwartungen an Service und zwischenmenschliche Interaktionen, wenn alles zunehmend automatisiert wird?

🤖 AI-TOOLS

Gemini 2.0 Flash Experimental: Bilderstellung und -bearbeitung direkt über den Chat (mehr oben in den News) (Link).

R1-Omni: Alibabas Open-Source-Modell für multimodales Reasoning, das Emotionen lesen kann (Link).

Freepik AI Video Upscaler: Skaliere Videos mit niedriger Qualität mit nur einem Klick auf 4K (Link).

1B CSM: Sesames neues open-source Text- und Audio-zu-Sprache-Modell (Link).

Prompt Engineering Studio: Setze AI-Prompts in mehr als 1600 Modellen ein (Link).

🧑🏫 AI-TUTORIAL DER WOCHE

Code mit KI direkt im Editor bearbeiten

Du möchtest eine Landing Page erstellen oder deinen Code optimieren, ohne ständig zwischen Programmen hin- und herwechseln zu müssen? Mit der ChatGPT-App für macOS kannst du Code direkt in deinem Editor bearbeiten.

So funktionierts:

Erweiterung installieren: Öffne deinen Editor (z. B. VS Code oder Cursor) und suche im Marktplatz nach „OpenAI ChatGPT“. Oder lade die VSIX-Datei herunter, wenn du einen anderen Editor verwendest.

ChatGPT verbinden: Starte die ChatGPT-App und gehe zum „Mit Apps arbeiten“-Panel. Wähle deinen Editor aus, öffne eine Code-Datei, und die Verbindung erfolgt automatisch.

Code bearbeiten und optimieren: Stelle Fragen oder bitte um Änderungen in natürlicher Sprache. Klicke auf „Anwenden“, um die Änderungen direkt umzusetzen.

So erstellst und optimierst du deinen Code direkt im Editor – schnell und ohne unnötige Umwege. Ein Beispiel: Du gibst den Prompt „Erstelle eine minimalistische HTML- und CSS-Landing-Page mit Header und Call-to-Action“ ein. ChatGPT liefert dir den Code, den du sofort im Editor weiter anpassen kannst – ohne Copy & Paste.

Viel Spaß beim Ausprobieren!

Das war’s für dieses Woche. Vielen Dank fürs Lesen!

Dir hat der Newsletter gefallen? Dann freue ich mich, wenn du ihn an deine Freunde weiterleitest. 🤗 (Anmeldelink).

Hier kannst du gerne meine vorherigen Newsletter durchstöbern.

Bis nächste Woche!

Henry